سئو چیست و چه کاربردی دارد ؟

بهینهسازی موتور جستجو (یا Search Engine Optimization)، که به صورت مخفف “سئو” (یا SEO) شناخته میشود، یک روند مناسب برای بهتر دیدهشدن یک وبسایت یا یک صفحه وبسایت در نتایج جستجو طبیعی موتور های جستجو مثل گوگل یاهو و بینگ است. معمولاً وبسایتهایی که در ابتدای نتایج و بیشترین تکرار در صفحه نتایج جستجو را دارند، بازدیدکننده بیشتری از طریق موتورهای جستجو به دست میآوردند و این بازدیدکنندگان میتوانند به مشتری یا کاربر واقعی و فعال سایت تبدیل شوند.

سئو یک وبسایت به منظور جذب کاربر و بیشتر دیده شدن بیشتر ممکن است انواع مختلف جستجو را دربرگیرد مثل انواع جستجو تصویر، جستجو در ویدیو، جستجوی دانشگاهی، جستجو در اخبار و جستجو در نقشه. «سئو» یک سایت شامل فاکتورهای بسیار زیادی میشود، که توسط موتورهای جستجو بررسی و بازبینی میشود.

از دید بازاریابی اینترنتی، “سئو” به چگونگی کار کردن موتورهای جستجو و اینکه کاربران چه چیزی جستجو میکنند و همینطور کلمات کلیدی تایپشده و اینکه کدام یک از موتورهای جستجو توسط مخاطبان مورد توجه قرار میگیرد را مورد بررسی قرار میدهد.

بهینهسازی وبسایت، شامل توسعه و ویرایش مطالب موجود در خود سایت و اچتیامال و برنامهنویسی و همچنین ارتباط بین کلمات کلیدی و حذف موانع مربوط به فعالیتهای نمایهسازی در موتور جستجو و ترویج یک سایت، برای افزایش تعداد لینکدهنده یا لینکهای ورودی و دیگر تاکتیکهای جستجوگرها است.

در نتیجه در خلاصهترین تعریف “سئو سایت” را میتوان به معنای بهینهسازی سایت برای موتورهای جستجو دانست.

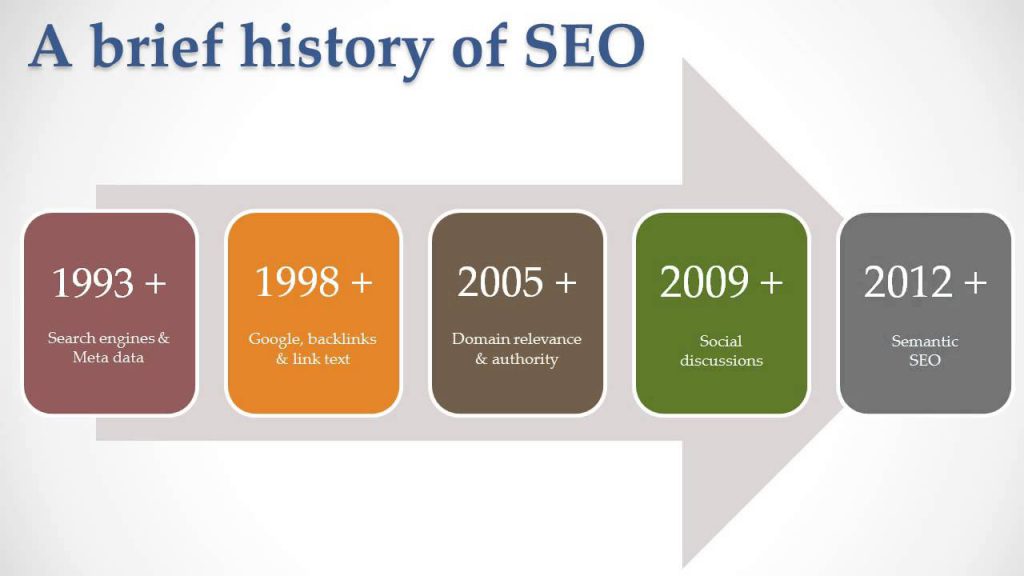

تاریخچه سئو در موتورهای جستجو

از اواسط دهه ۱۹۹۰ میلادی که نخستین موتورهای جستجو اقدام به فهرست کردن(ایندکس کردن) محتوای وب برای نخستین بار کردند، مدیران وبسایتها و تولیدکنندگان محتوا، شروع به بهینهسازی وبسایتها برای موتورهای جستجو نمودند.

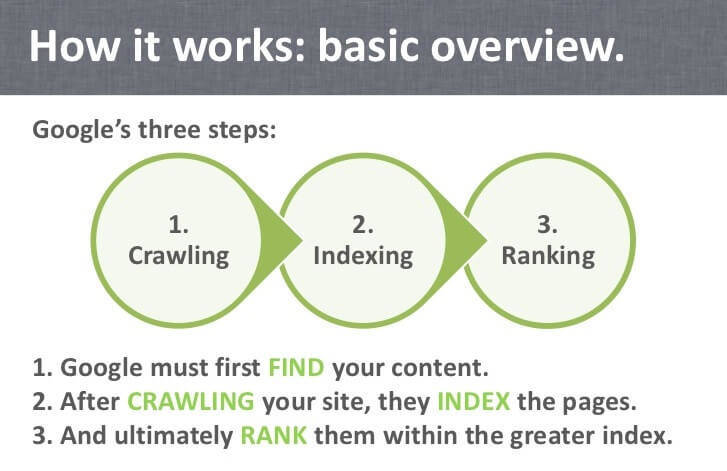

در ابتدا تمام کارهایی که مدیران وبسایتها باید انجام میدادند، ارسال آدرس صفحه به موتورهای مختلفی که یک عنکبوت (مثل ربات خزش گر) جهت خزش(به منظور پیمایش صفحات وب) آن صفحه میفرستادند، استخراج لینکهای صفحه به سایر صفحات از درون صفحه و بازگرداندن اطلاعات یافتشده در صفحه، جهت ایندکسشدن (فهرست شدن در نتایج) بود.

فرایند (که به این فرایند Crew گفته میشود) به این صورت است که عنکبوت موتور جستجو، یک صفحه را دانلود و آن را در سرور موتور جستجو ذخیره میکند و یک برنامه دیگر موسوم به ایندکسکننده، اطلاعات مختلفی را درباره صفحه استخراج میکند. اطلاعاتی از قبیل واژههای موجود و محل قرارگیری آنها در صفحه و نیز وزن خاص واژههای بهخصوص و تمام لینکهای موجود در صفحه، که سپس جهت خزش در زمانی دیگر، در دستور کار قرار میگیرد.

مدیران سایتها شروع به بازشناسی ارزش رتبه بالای سایت خود و در دید قرار گرفتن آن در نتایج موتورهای جستجو نمودند که این امر، فرصتی را برای هکرهای غیرمخرب و مخرب شاغل در بخش بهینهسازی موتور جستجو مهیا کرد (در روش سئو کلاه سیاه ازین الگوریتم های پیمایش صفحه به منظور دور زدن موتورهای جستجو استفاده میشد) .

نسخههای اولیه الگوریتمهای جستجو به اطلاعات فراهمشده توسط مدیران وبسایتها، نظیر متا تگ واژههای کلیدی، یا فایل ایندکس موتورهای جستجو، مانند ایالآیوب اعتماد و اتکا میکردند. متاتگها یک راهنمایی برای محتوای هر صفحه فراهم میکنند.

با این حال، استفاده از دادههای متا در صفحات ایندکس، کمتر قابل اطمینان بود ، زیرا انتخاب واژگان در یک متاتگ توسط وبسایتها، بالقوه میتواند یک نمایش غیردقیق از محتوای واقعی وبسایت باشد. دادههای نادرست، ناقص و ناسازگار در متا تگها میتواند موجب رتبهبندیشدن صفحه برای جستجوهای غیرمرتبط گردد. تولیدکنندگان محتوای شبکه، همچنین تعدادی از ویژگیهای منبع اچتیامال، یک صفحه را دستکاری کردند تا رتبه صفحه را در موتورهای جستجو بهبود بدهند.

با تأکید بر عواملی مانند تراکم واژه کلیدی، که بهطور انحصاری تحت کنترل مدیر وبسایت است، موتورهای جستجوی اولیه از سوءاستفاده و دستکاری رتبهبندی رنج میبردند.

ازآنجاییکه موفقیت و محبوبیت یک موتور جستجو از طریق توانایی آن در تولید نتایج مرتبطتر در قبال هر جستجوی صورت گرفته مشخص میشود، کیفیت پایین یا نتایج نامرتبط میتواند سبب سوق دادن کاربران به منابع جستجوی دیگر شود. موتورهای جستجو با توسعه الگوریتمی رتبهبندی پیچیدهتر به این عمل پاسخ دادند که در آن عوامل بیشتری مورد توجه قرار میگیرند و دستکاری را برای مدیران شبکه، سختتر میسازند.

بهمنظور ارائه نتایج بهتر به کاربران خود، موتورهای جستجو باید انطباق یافته و از نتایج صفحاتی اطمینان یابند که نتایج مرتبطتری دارند، نه نتایج مربوط به صفحاتی که نامربوط بوده و توسط مدیران شبکه بدون وجدان کاری و با استفاده از کلمات کلیدی متعدد پرشدهاند.

لری پیج و سرگئی برین، دو دانشجوی فارغالتحصیل دانشگاه استنفورد، یک موتور جستجو موسوم به بکروب را توسعه دادند که جهت ارزیابی برجستگی صفحات وب، به یک الگوریتم ریاضیاتی تکیه داشت. عددی که توسط الگوریتم محاسبه میشد، یعنی رتبه صفحه، تابعی است از مقدار و قدرت لینکهای ورودی. رتبه صفحه، میزان یک صفحه معین را که توسط یک کاربر، که بهصورت تصادفی شبکه را جستجو میکند، مورد دسترسی قرارگرفته، تخمین میزند و لینکهای یک صفحه به صفحه دیگر را دنبال میکند.

درواقع، این بدان معناست که برخی لینکها از سایر لینکها قویتر بوده، رتبه صفحه بالاتر احتمال دیده شدن صفحه توسط وبگردهای تصادفی را افزایش میدهد.

چرا سئو برای گوگل اهمیت دارد

تا سال ۱۹۹۷، طراحان موتورهای جستجو دریافتند که مدیران وبسایتها تلاش میکنند که در موتورهای جستجوی آنها رتبه بهتری داشته باشند. آنان همچنین متوجه شدند که برخی از مدیران وب، حتی رتبههای خود در نتایج جستجو را از طریق لبریز نمودن صفحات خود با واژگان کلیدی بسیار زیاد یا نامرتبط، دستکاری میکردند.

موتورهای جستجوی اولیه، نظیر آلتا ویستا یا اینفوسیک، الگوریتمهای خود را جهت جلوگیری مدیران وب در دستکاری رتبهها، مجدداً سازگار کردند.

در سال ۲۰۰۵، یک اجلاس سالانه موسوم به بازیابی اطلاعات خصمانه در وب (AIRWeb) صورت گرفت تا شاغلان و محققان مرتبط با موتورهای جستجو و بهینهسازی آن را به هم مرتبط سازد. نکته قابلتأمل در مورد موتورهای جستجو این است که نیاز نیست در تمام موتورهای جستجو سئو انجام دهید. جالب است بدانید ۹۷٪ جستجوهای کل دنیا از طریق موتور جستجوی گوگل انجام میشود و کارشناسان و مدیران وب تمایل بیشتری به سئوسازی روی گوگل داشته و سئو خود را متمرکز به گوگل میکنند.

تاثیر سئو برای ایندکس شدن در نتایج جستجو

موتورهای جستجوی مهم مثل جستجوگر گوگل، بینگ و یاهو از خزندهها جهت پیداکردن صفحات مرتبط با نتایج جستجوی الگوریتمیک خود استفاده میکنند. صفحاتی که از صفحات ایندکسشده یک موتور جستجوی دیگر لینک میشوند، نیازی به ارسال ندارد زیرا بهطور خودکار پیدا میشوند.

دو دایرکتوری عمده یاهو دایرکتوری، دیموز نیازمند ارسال دستی و بازنگری انسانی هستند. شرکت گوگل، Google Search Console را پیشنهاد میدهد که یک فید نقشه سایت xml میتواند برای آن ایجاد و بهطور رایگان ارسال شود تا این اطمینان حاصل شود که تمامی صفحات، خصوصاً آنهایی که با دنبال کردن خودکار لینکها قابلشناسایی نیستند، قابلدستیابی هستند. در گذشته یاهو، یک سرویس ارسال پرداختی داشت که خزش را به ازای مقداری هزینه در هر کلیک تضمین میکرد؛ که در سال ۲۰۰۹، این سرویس متوقف شد. خزندههای موتور جستجو میتوانند هنگام خزش یک وبسایت، به تعداد عوامل مختلفی توجه کنند. هر صفحهای توسط موتور جستجو ایندکس نمیشود. فاصله صفحات از دایرکتوری اساسی ممکن است یک عامل در خزش یا عدم خزش در صفحات باشد که توجه به این موارد و بهینه سازی آن جز سئو لینک سازی صفحات داخلی محسوب میشود.

جلوگیری از خزش (جلوگیری از ایندکس شدن در فهرست جستجو)

بهمنظور جلوگیری از محتوای نامطلوب در ایندکسهای جستجو، مدیران شبکه میتوانند به عنکبوتها (Spider) دستور بدهند که فایلها یا دایرکتوریهای خاصی را درون فایل استاندارد robots.txt در دایرکتوری اصلی دامنه، مورد بررسی و خزش (Crawl) قرار ندهند. بهعلاوه، یک صفحه میتواند صراحتاً از پایگاه دادهها مورد جستجو خارج شود که این عمل از طریق استفاده از متاتگهای مخصوص به رباتها صورت میگیرد. هنگامی که یک موتور جستجو از یک سایت بازدید میکند فایل robots.txt واقع در دایرکتوری اصلی، نخستین جایی است که مورد خزش قرار میگیرد. سپس فایل robots.txt تجزیه شده و به ربات دستور داده میشود که کدام صفحات نباید مورد بررسی و خزش قرار گیرد. از آنجایی که خزنده موتور جستجو ممکن است که یک نسخه از این فایل را نگه دارد، گاهی ممکن است که صفحاتی مورد خزش قرار گیرند که مدیر شبکه تمایلی به آنها ندارد. بهطور معمول، صفحاتی که از خزش خارج میشوند عبارتاند از صفحات ورودی خاص، مانند صفحات مربوط به کارتهای خرید و صفحات مربوط به محتوای شخصی کاربر، نظیر نتایج جستجوی حاصل از جستجوهای داخلی. در مارس ۲۰۰۷، گوگل به مدیران شبکه هشدار داد که باید از ایندکسشدن نتایج جستجوی داخلی جلوگیری کنند زیرا این صفحات، هرزنامه جستجو هستند. در ادامه بحث گفتنی است: نبود سایت مپ sitemap نیز مانع از آن میشود که ربات درک درستی از صفحات شما داشته باشد. همواره یک سایت مپ خوب تأثیر بسیار مهمی در خزش درست و خواندن کامل صفحات شما را دارد.

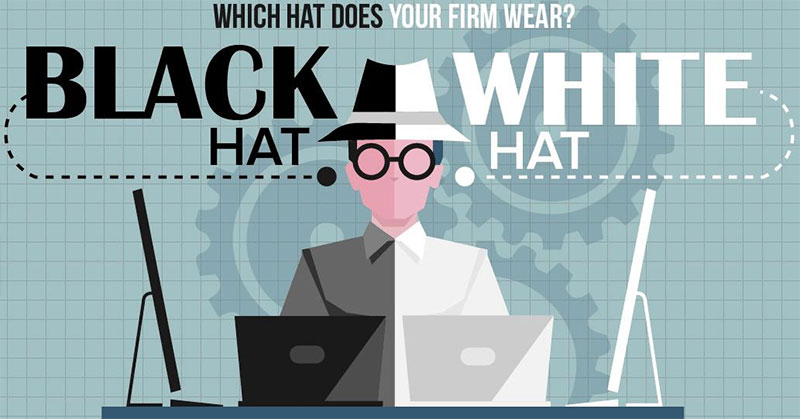

روش های کلاه سفید و کلاه سیاه در سئو

روشهای سئو را میتوان به دو دسته طبقهبندی کرد : روشهای کلاه سفید در مقابل تکنیکهای کلاه سیاه

روش سئو کلاه سفید : این روش مطابق با استاندارهای موتورهای جستجو است و هدف از سئو نمایش بهتر و سریع تر محتوای سایت به موتورهای جستجو است.

روش سئو کلاه سیاه : این روش مطابق با استانداردهای موتورهای جستجو نیست و هدف فقط جذب کاربر و بازدیدکننده به سایت از طریق ایندکس شدن در کلمات پرجستجوی بی ربط به محتوای صفحه و به صورت کلی تقلب در رتبه گرفتن بدون رضایت کاربران بازدیدکننده از نتایج میباشد .

موتورهای جستجو سعی دارند تا استفاده از روش دوم را به حداقل برسانند. دریافت نتیجه در روش سئو کلاه سفید زمان طولانیتری میبرد ولی دائمی است . در حالی که دریافت نتیجه در در روش سئو کلاه سیاه، سریعتر انجام میشود ولی موقتی است و هنگامی که موتورهای جستجو پی به این رفتارهای غیراصولی ببرند، سایت را جریمه خواهند کرد.

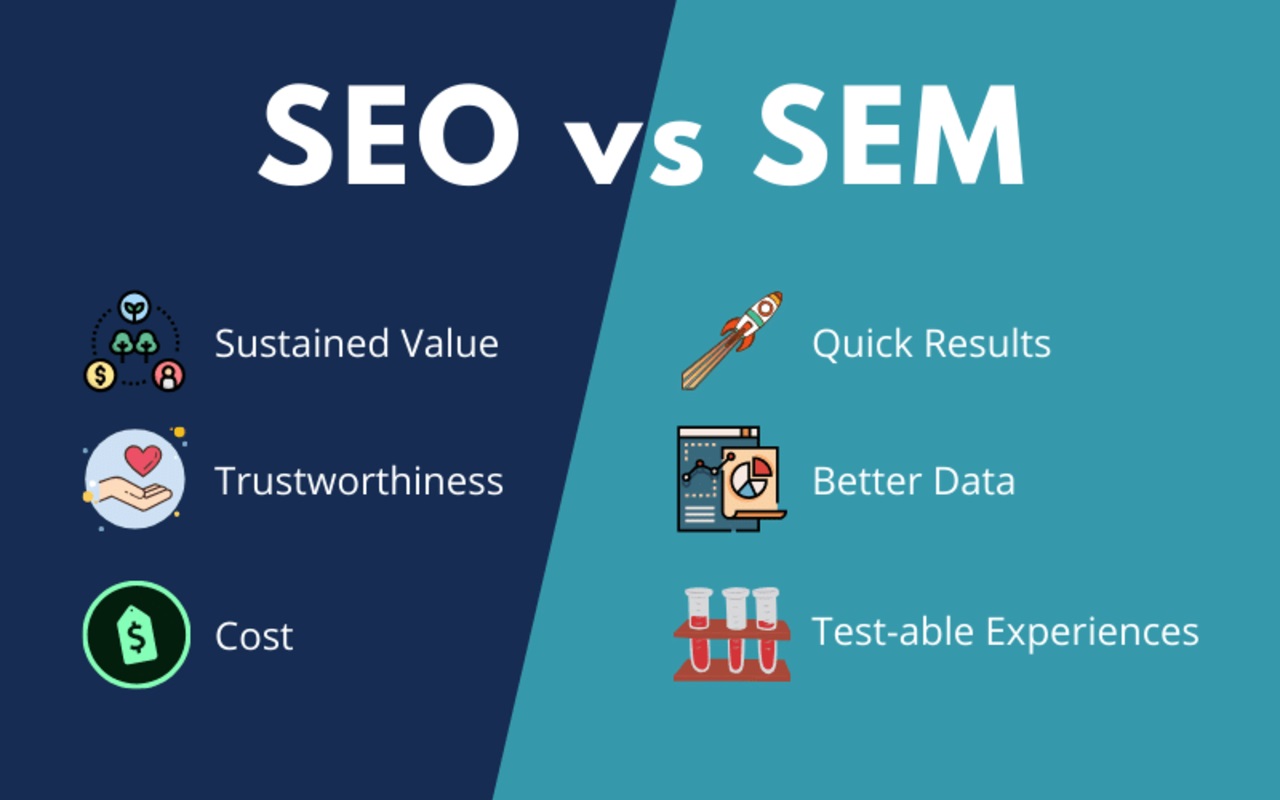

استفاده از سئو در بازاریابی آنلاین

سئو یک روش و استراتژی بازاریابی مناسب برای همه وبسایتها نیست و بر اساس هدف گردانندگان یک وبسایت، استراتژیهای بازاریابی اینترنتی دیگر مانند تبلیغات از طریق پرداخت کلیکی یا تبلیغات خاص در وب سایت های خاص مثل تبلیغات بنری میتواند مؤثرتر باشد.

مهمترین استراتژی بازاریابی محتوا تمرکز بر سئو است. سئو دارای بیشترین تأثیر در این نوع از بازاریابی است. سئو در واقع بهینهسازی سایت برای رباتهای گوگل و دیگه موتورهای جستجو است. شاید تنها هدف همه سایتها رسیدن به صفحه اول گوگل باشد. برای رسیدن به صفحه اول گوگل باید سئو سایت خود را بهبود بخشیم. سئو یکی از مهمترین عاملها برای رشد سایت و پیشی گرفتن از سایتهای رقبا است. ساخت کمپینهای تبلیغاتی ، کدنویسی صحیح و بهینه سازی کدها ، لینک سازی و بک لینک از عوامل تأثیرگذار و اصلی در سئو هستند.

منابع : وب سایت بهترین سئو | سئو چیست ویکی پدیا